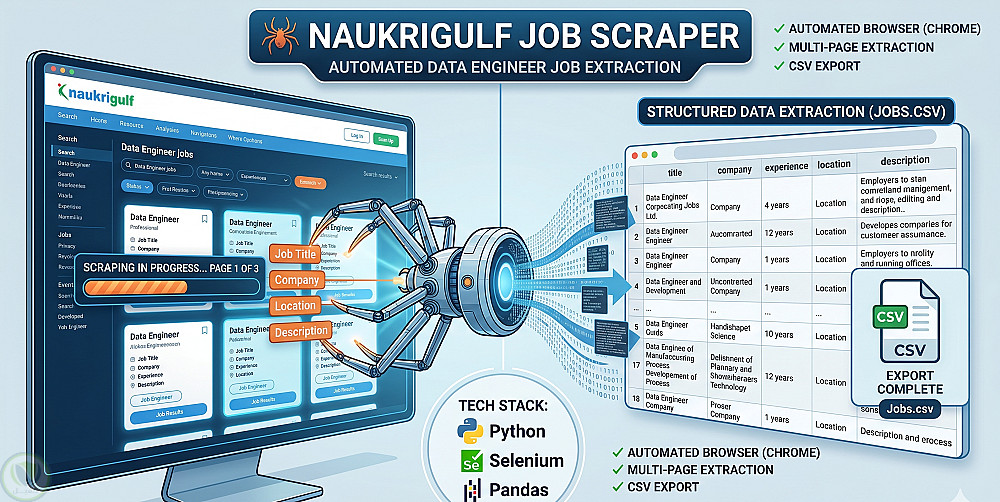

بناء أداة استخراج بيانات آلية (Web Scraper) للوظائف باستخدام Python و Selenium

منذ 3 أيام

عرض العمل

الوصف

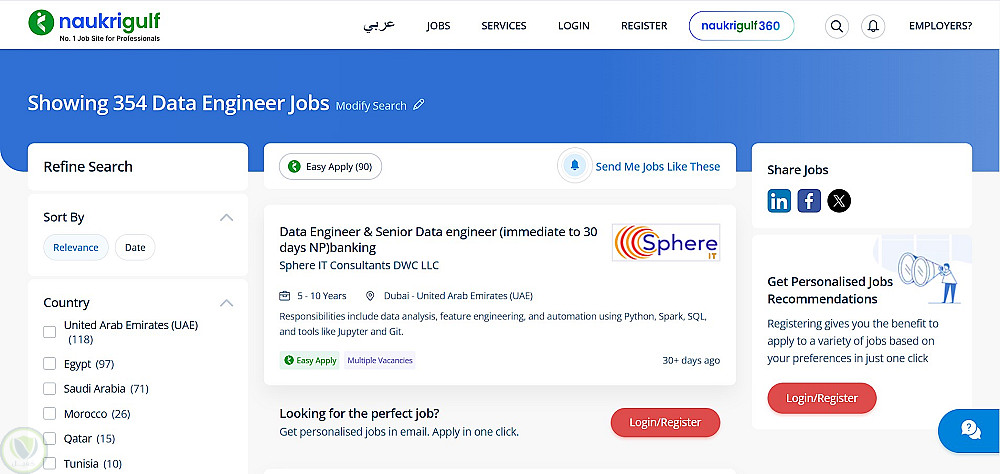

مشروع برمجي لأتمتة استخراج بيانات وظائف (هندسة البيانات) من منصة "Naukrigulf"، وتحويلها من صفحات ويب متفرقة إلى قاعدة بيانات مهيكلة وجاهزة للتحليل.

ملامح المشروع:

أتمتة متقدمة: استخدام (Selenium) لتشغيل متصفح آلي وتصفح الموقع مع تخطي آليات حظر الروبوتات (Anti-detection).

التنقل التلقائي (Pagination): برمجة السكربت للتنقل بين صفحات نتائج البحث المتعددة لجمع البيانات دون أي تدخل بشري.

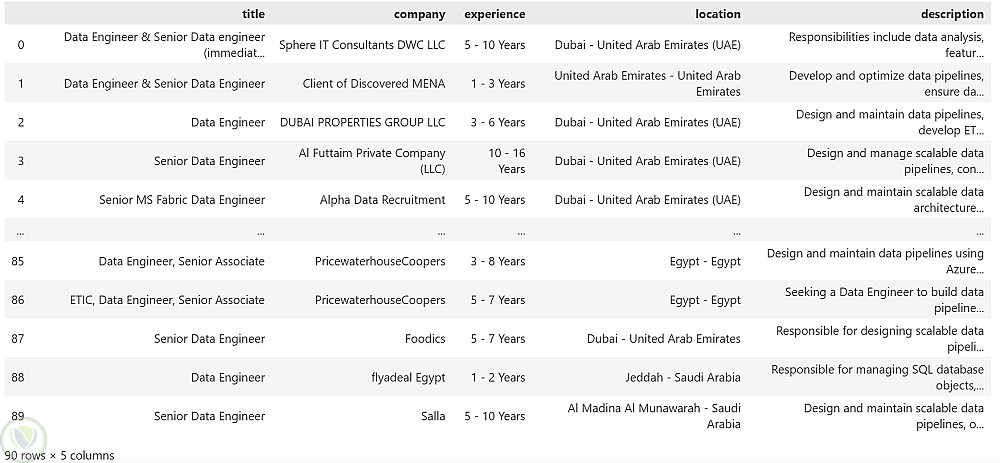

استخراج دقيق: سحب تفاصيل كل بطاقة وظيفية (المسمى، الشركة، الخبرة، الموقع الجغرافي، والوصف الوظيفي).

تنظيم وتصدير البيانات: تنظيف البيانات المستخرجة باستخدام (Pandas) وتصديرها كملف (CSV) جاهز للاستخدام.

التقنيات المستخدمة:

لغة البرمجة: Python

أتمتة المتصفح: Selenium WebDriver

معالجة البيانات: Pandas

أدوات مساعدة: مكتبة Time لإدارة سرعة استجابة السكربت وتجنب الحظر.

يُبرز هذا العمل مهاراتي في جمع البيانات الآلية (Data Ingestion) من المصادر غير المهيكلة، وهي الخطوة الأساسية في أي مسار لهندسة البيانات (Data Pipeline).

التفاصيل

| المشاهدات | 0 |

| المفضلة | 0 |

| القسم | برمجة, تطوير المواقع و التطبيقات - اخري |

حساب المستخدم

العربية

العربية

English

English